Hơn 30 chuyên gia AI hàng đầu lên tiếng ủng hộ Anthropic trong vụ kiện chống lại Bộ Quốc phòng Mỹ

Một nhóm gồm hơn 30 nhân viên cấp cao từ hai gã khổng lồ công nghệ OpenAI và Google DeepMind đã chính thức đệ trình văn bản pháp lý vào thứ Hai vừa qua, bày tỏ sự ủng hộ mạnh mẽ đối với vụ kiện của công ty trí tuệ nhân tạo Anthropic chống lại Bộ Quốc phòng Hoa Kỳ (DOD). Động thái này diễn ra ngay sau khi cơ quan liên bang này quyết định gắn mác Anthropic là một rủi ro chuỗi cung ứng, theo các hồ sơ tòa án được công bố.

Lý do vụ kiện và phản ứng từ giới chuyên gia

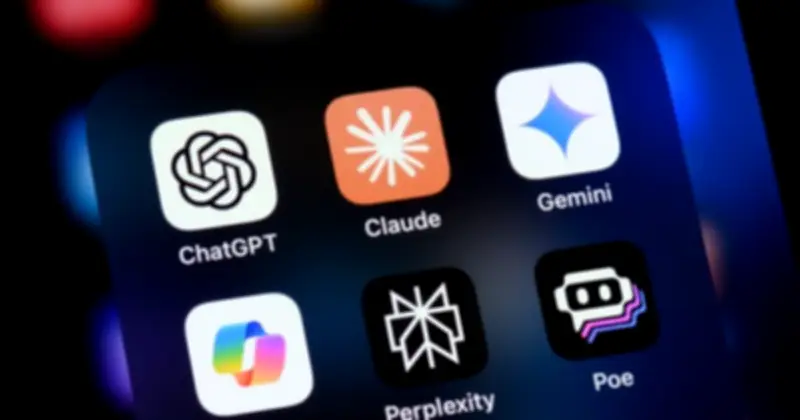

Bản tóm tắt pháp lý, với sự tham gia ký tên của những nhân vật có ảnh hưởng như Jeff Dean - nhà khoa học trưởng của Google DeepMind, đã nêu rõ quan điểm: “Việc chính phủ chỉ định Anthropic là rủi ro chuỗi cung ứng là một hành động lạm dụng quyền lực không đúng đắn và độc đoán, gây ra những hậu quả nghiêm trọng cho ngành công nghiệp của chúng ta”. Văn bản này xuất hiện trên hồ sơ tòa án chỉ vài giờ sau khi nhà phát triển AI Claude (thuộc Anthropic) đệ trình hai vụ kiện riêng biệt chống lại Bộ Quốc phòng và các cơ quan liên bang khác.

Nguyên nhân trực tiếp dẫn đến vụ kiện bắt nguồn từ cuối tuần trước, khi Lầu Năm Góc chính thức gắn mác Anthropic là rủi ro chuỗi cung ứng - một danh hiệu thường được dành cho các đối thủ nước ngoài. Quyết định này được đưa ra sau khi Anthropic kiên quyết từ chối cho phép Bộ Quốc phòng sử dụng công nghệ AI của mình cho các mục đích nhạy cảm như giám sát hàng loạt người Mỹ hoặc kích hoạt vũ khí tự động. Phía Bộ Quốc phòng lập luận rằng họ nên có quyền sử dụng AI cho bất kỳ mục đích “hợp pháp” nào và không bị hạn chế bởi các điều khoản từ một nhà thầu tư nhân.

Những hệ lụy tiềm ẩn và phản đối nội bộ

Trong hồ sơ tòa án, các nhân viên của Google và OpenAI đã nhấn mạnh một điểm quan trọng: nếu Lầu Năm Góc “không còn hài lòng với các điều khoản đã thỏa thuận trong hợp đồng với Anthropic”, cơ quan này hoàn toàn có thể “đơn giản là hủy bỏ hợp đồng và mua dịch vụ từ một công ty AI hàng đầu khác”. Tuy nhiên, thực tế lại diễn ra theo hướng khác khi Bộ Quốc phòng ngay lập tức ký kết một thỏa thuận với OpenAI ngay sau khi chỉ định Anthropic là rủi ro chuỗi cung ứng - một động thái mà chính nhiều nhân viên của nhà sản xuất ChatGPT đã lên tiếng phản đối.

Bản tóm tắt pháp lý cũng khẳng định rằng những “lằn ranh đỏ” mà Anthropic đưa ra thực chất là những mối lo ngại chính đáng, đòi hỏi phải có những rào cản mạnh mẽ để bảo vệ. Văn bản chỉ rõ: “Nếu không có luật công khai để quản lý việc sử dụng AI, các hạn chế về hợp đồng và kỹ thuật mà các nhà phát triển áp đặt lên hệ thống của họ là một biện pháp bảo vệ quan trọng chống lại việc lạm dụng thảm khốc”.

Cảnh báo về tương lai ngành AI Mỹ

Các chuyên gia đã đưa ra lời cảnh báo nghiêm túc về hậu quả lâu dài: “Nếu được phép tiếp diễn, nỗ lực trừng phạt một trong những công ty AI hàng đầu của Hoa Kỳ chắc chắn sẽ gây ra hậu quả cho năng lực cạnh tranh công nghiệp và khoa học của Hoa Kỳ trong lĩnh vực trí tuệ nhân tạo và hơn thế nữa”. Đồng thời, họ cũng lo ngại rằng động thái này “sẽ làm giảm sự thảo luận cởi mở trong lĩnh vực của chúng ta về những rủi ro và lợi ích của các hệ thống AI hiện nay”.

Đáng chú ý, nhiều nhân viên đã ký tên vào bản tuyên bố ủng hộ Anthropic cũng chính là những người đã ký các thư ngỏ trong vài tuần qua. Những thư này kêu gọi Bộ Quốc phòng rút lại nhãn hiệu rủi ro chuỗi cung ứng đối với Anthropic, đồng thời thúc giục các lãnh đạo công ty của họ thể hiện sự ủng hộ đối với Anthropic và từ chối việc sử dụng hệ thống AI một cách đơn phương, thiếu minh bạch.

Sự kiện này không chỉ làm nổi bật mâu thuẫn giữa các công ty AI hàng đầu với chính phủ Mỹ, mà còn phản ánh những tranh cãi sâu sắc về đạo đức, trách nhiệm và giới hạn trong việc phát triển và ứng dụng trí tuệ nhân tạo vào các lĩnh vực nhạy cảm như quốc phòng và an ninh.