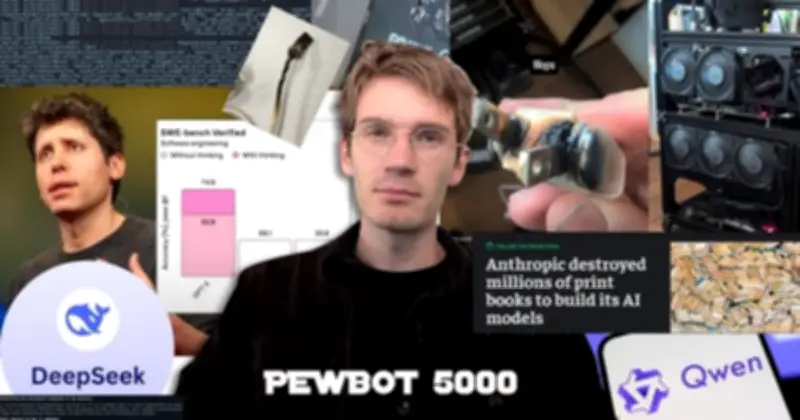

Hành trình tự huấn luyện AI lập trình của PewDiePie: Từ tham vọng đến thực tế

Streamer nổi tiếng PewDiePie vừa công bố chi tiết hành trình kéo dài nhiều tháng trong việc tự huấn luyện một mô hình trí tuệ nhân tạo, với mục tiêu chính là cải thiện khả năng lập trình. Trong video mới nhất, anh tiết lộ rằng mô hình do mình tinh chỉnh đã có thời điểm vượt qua GPT-4 trên một bài benchmark lập trình cụ thể, nhưng sau đó phát hiện kết quả bị sai lệch do trùng dữ liệu huấn luyện.

Khởi đầu từ mô hình có sẵn và mục tiêu học hỏi

PewDiePie thừa nhận không xây dựng AI từ con số 0, mà chỉ fine-tune một mô hình ngôn ngữ lớn có sẵn, cụ thể là phiên bản 32B của Qwen 2.5. Mục đích của anh không phải để cạnh tranh thương mại, mà để học cách huấn luyện AI và hiểu rõ quy trình đằng sau các hệ thống phức tạp này.

Benchmark Aider Polyglot và những thách thức ban đầu

Anh sử dụng benchmark có tên Aider Polyglot, một bài kiểm tra đánh giá khả năng lập trình ở nhiều ngôn ngữ khác nhau. Theo PewDiePie, các mô hình hàng đầu như DeepSeek 2.5 hay Llama 4 Maverick chỉ đạt khoảng hơn 18% ở định dạng diff format. Mô hình ban đầu anh chọn để huấn luyện chỉ đạt 8%, và khi đổi sang định dạng khác có thể lên 16%.

Quá trình thu thập và xử lý dữ liệu đầy rủi ro

Từ đó, PewDiePie bắt đầu thu thập và xử lý dữ liệu. Anh cho biết đã tổng hợp khoảng 100.000 mẫu dữ liệu theo dạng bài toán - lời giải, kết hợp dữ liệu công khai, dữ liệu từ GitHub và cả dữ liệu tổng hợp do AI mạnh hơn tạo ra. Tuy nhiên, anh cũng thừa nhận dữ liệu tổng hợp có rủi ro cao vì AI có thể tạo ra lời giải trông đúng nhưng thực chất sai.

Những lần huấn luyện thất bại và cải tiến

Sau nhiều tháng chuẩn bị, lần huấn luyện đầu tiên khiến mô hình còn tệ hơn ban đầu. PewDiePie phát hiện vấn đề nằm ở bộ kiểm thử và dữ liệu nhiễu. Sau khi sửa lại, điểm số ổn định quanh mức 16%, tương đương trần hiệu suất trước đó. Để cải thiện thêm, anh bổ sung dữ liệu có phần "reasoning", buộc mô hình phải viết ra các bước suy nghĩ trước khi đưa ra lời giải. Sau khi fine-tune thêm khoảng 15.000 mẫu reasoning, điểm số ban đầu đạt 17%.

Khoảnh khắc vượt GPT-4 và phát hiện lỗi trùng dữ liệu

Ở một lần chạy, mô hình đạt 19,6%, và PewDiePie tuyên bố đã vượt GPT-4 ở thời điểm tháng 11. Tuy nhiên, ngay sau đó anh phát hiện hiện tượng benchmark contamination - tức dữ liệu huấn luyện có thể trùng với câu hỏi trong bộ kiểm tra. Sau khi rà soát lại, anh xác nhận có một phần dữ liệu bị trùng và quyết định hủy kết quả này.

Chuyển sang phiên bản chuyên biệt và cải thiện điểm số

Không dừng lại, PewDiePie huấn luyện lại trên toàn bộ tập dữ liệu và đồng thời phát hiện trước đó mình đã fine-tune nhầm phiên bản thường thay vì phiên bản chuyên lập trình của Qwen 2.5. Khi chuyển sang bản coder chuyên biệt, kết quả ban đầu thậm chí rơi xuống 4,4%. Sau khi điều chỉnh và huấn luyện lại, điểm số tăng lên 25%. Một phát hiện khác cho thấy benchmark chưa chạy đầy đủ các phần như C++ và JavaScript. Sau khi sửa lại bài test, mô hình đạt 36%. Tiếp tục hậu huấn luyện thêm 1.500 mẫu trong 5 epoch, điểm số cuối cùng đạt 39,1%.

Sự cố phần cứng và nhận định thực tế

Toàn bộ quá trình không chỉ gặp lỗi phần mềm mà còn nhiều sự cố phần cứng. PewDiePie cho biết từng làm cháy dây nguồn do hệ thống tiêu thụ hơn 2.000 W, một GPU bị hỏng và máy tính liên tục gặp lỗi do cấu hình tự lắp ghép để đáp ứng tải tính toán cao. Anh nhấn mạnh rằng đạt điểm cao ở một benchmark không đồng nghĩa với năng lực toàn diện, và cần kiểm tra thêm trên các bài test khác như SWE-bench trước khi cân nhắc chia sẻ mô hình công khai.

Kết luận: Hành trình học hỏi từ thất bại

Dù vậy, PewDiePie cũng thừa nhận ngay sau khi hoàn thành, phiên bản Qwen 3 đã ra mắt và đạt khoảng 40% trên cùng benchmark, đồng nghĩa mô hình của anh vẫn chưa vượt qua thế hệ mới nhất. Với anh, dự án này chủ yếu là hành trình học hỏi thông qua thất bại và thử nghiệm, thay vì tạo ra một sản phẩm cạnh tranh trực tiếp với các công ty AI lớn.